機器學習的基礎圖表!(2)

三、機器學習的算法

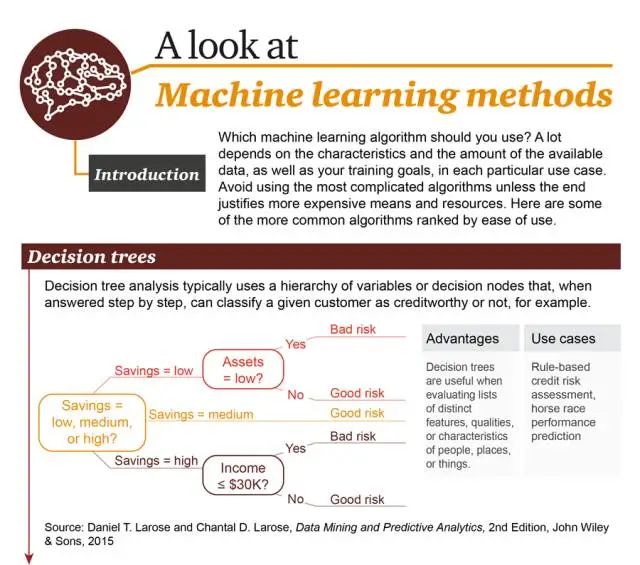

你應該使用哪種機器學習算法?這在很大程度上依賴于可用數據的性質和數量以及每一個特定用例中你的訓練目標。不要使用最復雜的算法,除非其結果值得付出昂貴的開銷和資源。這里給出了一些最常見的算法,按使用簡單程度排序。

1. 決策樹(Decision Tree):在進行逐步應答過程中,典型的決策樹分析會使用分層變量或決策節點,例如,可將一個給定用戶分類成信用可靠或不可靠。

優點:擅長對人、地點、事物的一系列不同特征、品質、特性進行評估

場景舉例:基于規則的信用評估、賽馬結果預測

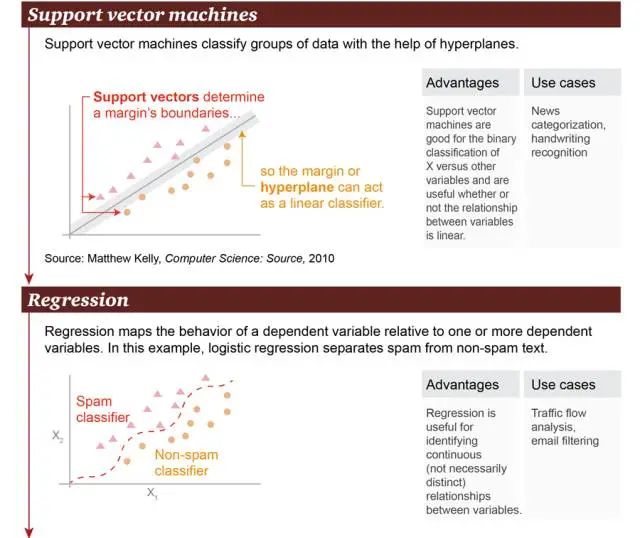

2. 支持向量機(Support Vector Machine):基于超平面(hyperplane),支持向量機可以對數據群進行分類。

優點:支持向量機擅長在變量 X 與其它變量之間進行二元分類操作,無論其關系是否是線性的

場景舉例:新聞分類、手寫識別。

3. 回歸(Regression):回歸可以勾畫出因變量與一個或多個因變量之間的狀態關系。在這個例子中,將垃圾郵件和非垃圾郵件進行了區分。

優點:回歸可用于識別變量之間的連續關系,即便這個關系不是非常明顯

場景舉例:路面交通流量分析、郵件過濾

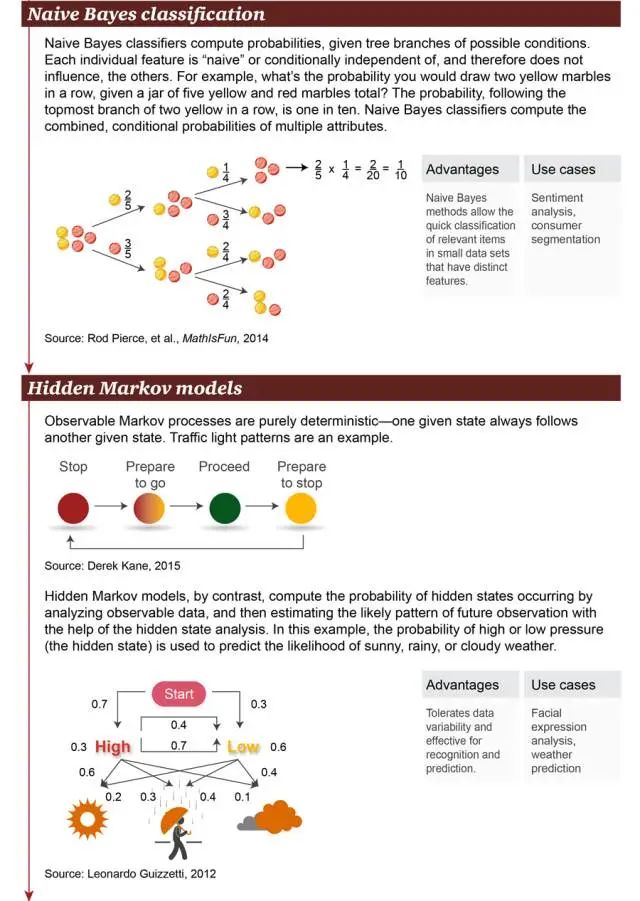

4. 樸素貝葉斯分類(Naive Bayes Classification):樸素貝葉斯分類器用于計算可能條件的分支概率。每個獨立的特征都是「樸素」或條件獨立的,因此它們不會影響別的對象。例如,在一個裝有共 5 個黃色和紅色小球的罐子里,連續拿到兩個黃色小球的概率是多少?從圖中最上方分支可見,前后抓取兩個黃色小球的概率為 1/10。樸素貝葉斯分類器可以計算多個特征的聯合條件概率。

優點:對于在小數據集上有顯著特征的相關對象,樸素貝葉斯方法可對其進行快速分類

場景舉例:情感分析、消費者分類

5. 隱馬爾可夫模型(Hidden Markov model):顯馬爾可夫過程是完全確定性的——一個給定的狀態經常會伴隨另一個狀態。交通信號燈就是一個例子。相反,隱馬爾可夫模型通過分析可見數據來計算隱藏狀態的發生。隨后,借助隱藏狀態分析,隱馬爾可夫模型可以估計可能的未來觀察模式。在本例中,高或低氣壓的概率(這是隱藏狀態)可用于預測晴天、雨天、多云天的概率。

優點:容許數據的變化性,適用于識別(recognition)和預測操作

場景舉例:面部表情分析、氣象預測

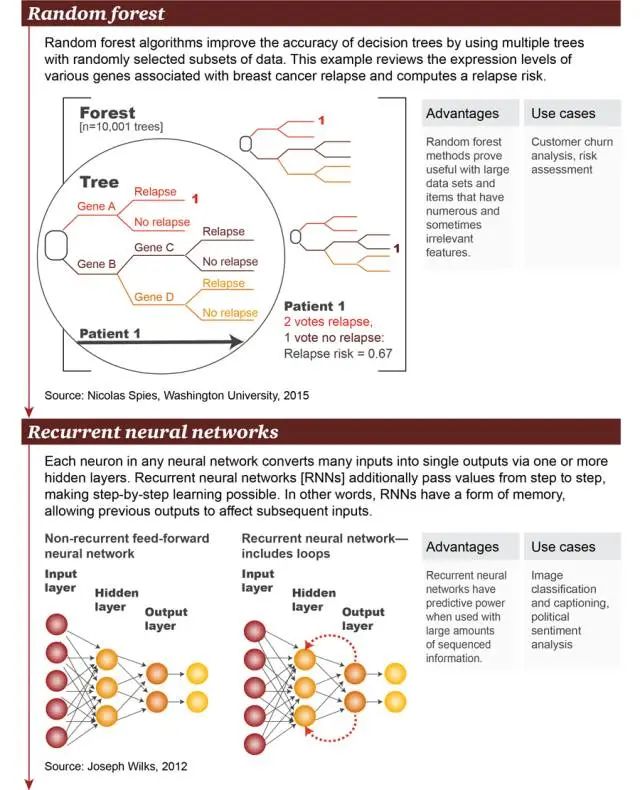

6. 隨機森林(Random forest):隨機森林算法通過使用多個帶有隨機選取的數據子集的樹(tree)改善了決策樹的精確性。本例在基因表達層面上考察了大量與乳腺癌復發相關的基因,并計算出復發風險。

優點:隨機森林方法被證明對大規模數據集和存在大量且有時不相關特征的項(item)來說很有用

場景舉例:用戶流失分析、風險評估

7. 循環神經網絡(Recurrent neural network):在任意神經網絡中,每個神經元都通過 1 個或多個隱藏層來將很多輸入轉換成單個輸出。循環神經網絡(RNN)會將值進一步逐層傳遞,讓逐層學習成為可能。換句話說,RNN 存在某種形式的記憶,允許先前的輸出去影響后面的輸入。

優點:循環神經網絡在存在大量有序信息時具有預測能力

場景舉例:圖像分類與字幕添加、政治情感分析

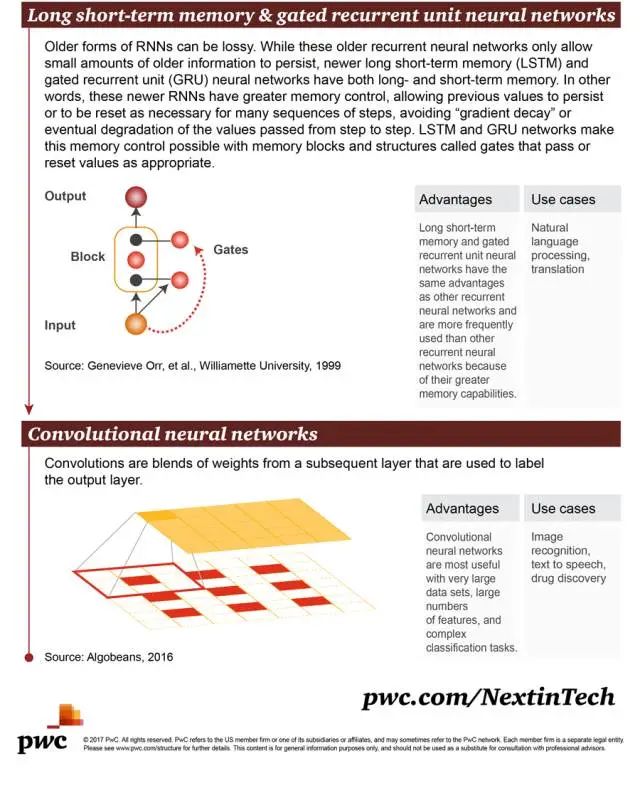

8. 長短期記憶(Long short-term memory,LSTM)與門控循環單元神經網絡(gated recurrent unit nerual network):早期的 RNN 形式是會存在損耗的。盡管這些早期循環神經網絡只允許留存少量的早期信息,新近的長短期記憶(LSTM)與門控循環單元(GRU)神經網絡都有長期與短期的記憶。換句話說,這些新近的 RNN 擁有更好的控制記憶的能力,允許保留早先的值或是當有必要處理很多系列步驟時重置這些值,這避免了「梯度衰減」或逐層傳遞的值的最終 degradation。LSTM 與 GRU 網絡使得我們可以使用被稱為「門(gate)」的記憶模塊或結構來控制記憶,這種門可以在合適的時候傳遞或重置值。

優點:長短期記憶和門控循環單元神經網絡具備與其它循環神經網絡一樣的優點,但因為它們有更好的記憶能力,所以更常被使用

場景舉例:自然語言處理、翻譯

9. 卷積神經網絡(convolutional neural network):卷積是指來自后續層的權重的融合,可用于標記輸出層。

優點:當存在非常大型的數據集、大量特征和復雜的分類任務時,卷積神經網絡是非常有用的

場景舉例:圖像識別、文本轉語音、****物發現

編輯:于騰凱

校對:汪雨晴

*博客內容為網友個人發布,僅代表博主個人觀點,如有侵權請聯系工作人員刪除。