智能噴灑:計算機視覺在農業機械自動化領域的小試牛刀

農業噴灑應用中的 AI 身影。

前言

噴灑 (spraying),主要指的是用農作物保護產品噴灑農作物。農作物保護產品的類型有很多,比如用來殺死雜草的除草劑、農****、營養液 / 化肥等。由于噴灑農****主要是為了保護農作物的生長,這一類操作也常常被稱為農業植保(Crop protection)。在本文中筆者將集中討論除(雜)草方面的自動化進程。

噴霧機器(sprayer),則顧名思義,是用于噴灑化學產品的設備。可能大家根據電視里想象的打農****的場景,一般是一個人背著帶有噴槍的背包行走在田間,對左右兩側的作物進行噴灑。實際上,這類噴霧機屬于體型較小的便攜式單元,現代農業使用的噴霧機器已經發展為大型設備,主要可以分為三類——安裝式(mounted)、拖掛式(trailed)、自走式(self-propelled),如下圖所示。前兩者不能自行移動,需要與拖拉機相連,而最后一類則整合了引擎、車廂等部件。安裝式和拖掛式的區別在于和拖拉機的連接方式,可以理解為安裝式噴霧器更像是一個「掛件」,而拖掛式噴霧器則自帶輪子,可以連接在拖拉機的尾部。具體使用哪種噴霧器,則要根據實際需求和成本考慮。由于拖拉機在整個農業周期中都承載著眾多的任務,是不可或缺的機器,而噴霧器只是在特定時期使用的機器,對于一些中小型農場來說購買安裝式或拖掛式噴霧器是更加經濟的選擇。

噴霧器。左:安裝式(mounted),中:拖掛式(trailed),右:自走式(self-propelled)。(圖源:https://www.beyne.be/en)

在噴霧器上,最惹人注目的部件應該就是噴桿(spray boom)了。根據作物的高度,噴桿一般安裝在 1.2 到 9 米之間的高度,而其臂長可以輕易達到 10-20 米左右,甚至 40 米以上。在噴桿上,等距離的布有噴嘴(nozzle),用于促進液體分散到噴霧中。在本文探討的智能噴灑(smart spraying)的產品中,對噴嘴的自動控制是開發過程中的一個重要環節。

自走式噴霧器展開的樣子。模型:Case Patriot 4430 Sprayer w/120 Foot Booms(圖源:https://www.youtube.com/watch?v=nfcbTHwPxi4)

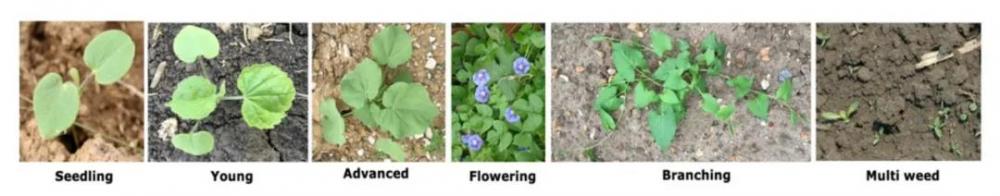

噴灑作業并不會涉及到非常復雜的流程,噴霧器的機械設計也很直觀,但要實現智能噴灑,在實踐過程中也有不少挑戰需要解決。第一個挑戰就是足夠的農業知識——要進行雜草防治,首先需要對常見的農作物和雜草有一定的了解。從下圖中可以看出,隨著雜草開花并分支,其形態與幼苗時期的樣子已經有了很大不同,而這還僅僅只是一種雜草。目前在歐洲范圍內大概就有 30,000 種雜草 [1],更遑論全世界范圍內了。許多雜草或與農作物的形態相似,或只在特定領域生長(比如美國的玉米農場就會生長一種在歐洲的玉米農田里見不到的雜草)。而十年前本地常見的雜草又和現在常見的雜草不一樣。要收集高質量——覆蓋范圍廣、有代表性、標注準確等——的數據,研發人員必須具有足夠的專業知識或與農學家密切合作。

此外,開發智能噴灑系統,并不僅僅只是為了取代目前的半人工噴灑,更是為了減少化學****品的使用。在食品受到嚴格監管的歐盟區,農業行業的發展很大程度上受到現有的或近期將會出臺的法律法規的影響。從 2014 年開始,病蟲害綜合治理(Integrated Pest Management ,IPM)在歐盟成為強制性措施,其中就包括負責任地使用農****和植物生物技術解決方案。由于目前環境問題越來越嚴苛,在接下來的幾年,預計會有更具體的措施出臺來進一步限制化學****品的使用量。因此,噴霧器作業的精準度必須進一步提升——甚至達到厘米級的精度——來符合更高的環保要求。相應的,這也對模型的推理速度,包括相應的控制系統的響應速度都提出了比較高的要求。

平心而論,一個農業產品即便是要實時達到厘米級的精度,其難度仍然很可能低于自動駕駛領域的一個實時應用,因為農業器械的作業速度要遠低于汽車駕駛的速度。比如噴灑除草劑時,拖拉機的時速一般不會超過 30 km/h。但這并不代表這樣的要求就沒有挑戰性。首先生產商能夠負擔的硬件設備是有限的,而為了能夠覆蓋噴灑的所有區域,噴桿上一般需要每個幾米安裝一個相機和足夠的算力來捕捉圖像并進行模型推理,然后在噴霧器上再配備單一控制系統來完成 GPS Mapping 等任務并操控所有的噴嘴。總體計算下來,每個相機可能只能配備一個相當于 Nvidia Jetson nano 的算力的 edge device。這樣的設備要運行進行圖像分割的神經網絡進行實時推理不是完全不會吃力的。實際上,Nvidia Jetson nano 并不總是工業自動化開發中一個好的算力設備選項。至少在農業領域,由于機器運行的環境可能會比較有挑戰性,并且在作業時機器內部可能會形成高振動、高溫或高濕度的環境,每個制造商都對使用的零部件有具體的要求——比如 IP 68 防水—— 而 Nvidia 家族的算力設備很多都沒有滿足生產商的要求。

另外,智能噴灑對噴霧器原有的硬件也是一個挑戰。筆者就見過噴霧器自帶的 driver 相應速度不夠快,導致噴嘴的控制速度跟不上模型的推理速度,或者噴桿太長導致末端的計算設備供電不足等各種始料不及的問題。一些其他的特定于植保領域的問題包括自然環境的挑戰性——風會干擾噴灑的精確性等、田野末端的過量噴灑——當噴霧器在田野末端掉頭返回田野的另一側繼續噴灑除草劑時,由于駕駛路線的重合,部分雜草會被重復檢測到,從而造成除草劑的過量噴灑。

但另一方面,智能噴灑涉及到的行業知識相對其他任務來說已經較少,進入壁壘不高。這本身也是一個適合計算機視覺的任務,隨著相關解決方案的成熟,目前市場競爭已經變得越來越激烈。宏觀來看,現有的解決方案可以大致分為三類:在噴霧器上添加智能模塊,田野機器人(field robot),無人機和噴霧器結合的解決方案。第一類一般是市場內現有的大型生產商主攻的方向,也有一些初創公司希望與生產商合作開發或直接將解決方案賣出,而不直接參與市場競爭;第二類則是很多初創公司或從其他領域轉入的公司的主攻方向,它們一般希望能夠參與市場競爭,與消費者有直接接觸;后者則很多是現有的農業無人機服務商提供的新特征。接下來筆者將對每一類的典型產品進行討論。

本文將集中討論各種創新性的智能噴灑機器人。從如何在一般噴霧器基礎上添加機器學習算法,到能夠替代完全噴霧器的新一代田野機器人,以及在研發過程中面對的各種實際挑戰。

在噴霧器上添加智能模塊

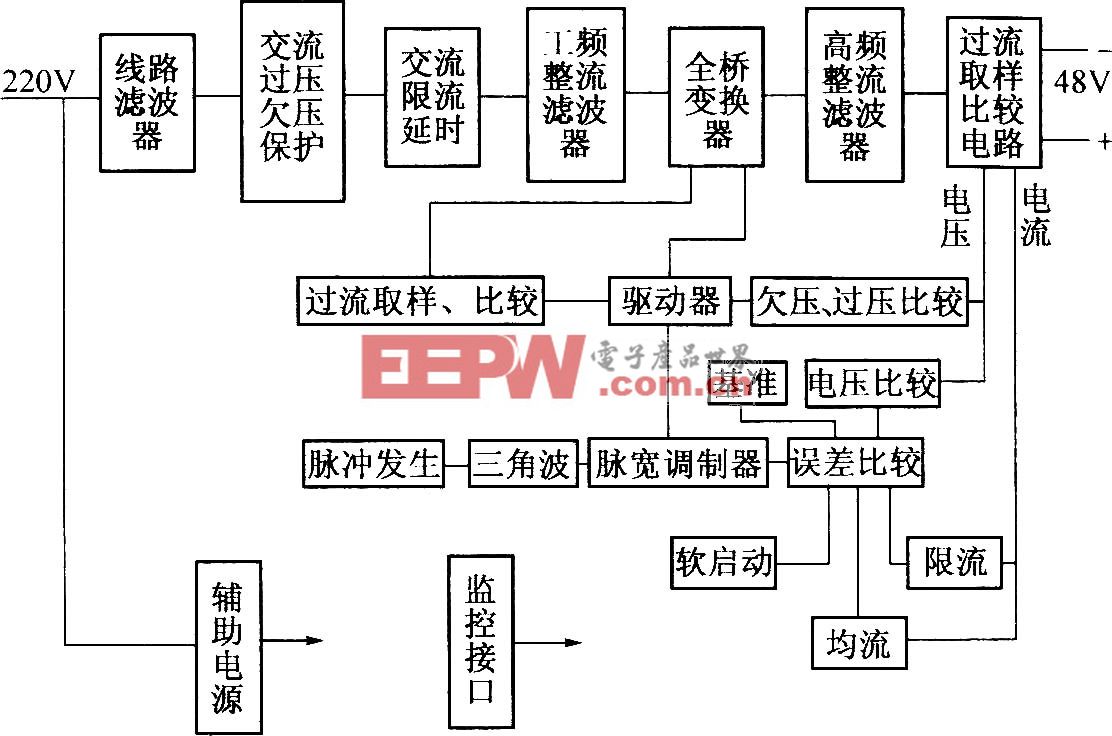

大部分產品的研發思路都是通過相機(RGB 或 Spectrum)拍攝噴霧器將要噴灑的區域,然后利用部署在相機上的計算機視覺算法識別區域內的雜草并計算雜草的相對或絕對位置,將該信息返回到控制系統中。后者會根據噴霧器自身的位置和速度以及雜草的位置,在到達雜草附近時開啟噴嘴,噴灑除草劑。這個思路不僅僅是適用于為噴霧器開發智能模塊,也包括開發機器人等其他手段,區別主要在于圖像獲取和推理的手段以及位置。

模型方面,各團隊都大同小異,無非是常見的那幾個圖像分割神經網絡,即便是非常簡單的 UNet 也可以取得不錯的表現。大部分工業界的研發工程師們對模型是不是足夠創新、是不是 SOTA 模型不會特別在意,能不能輕易的整合到現有的產品框架中重要的多。實際上, UNet 及其變體 ENet 往往受到青睞,原因有三。其一,模型推理速度不錯,并且結構簡單,對其進行壓縮、加速、優化等操作也非常方便;其二, 模型較小或者可以被輕易的縮小;其三,其使用的 operation 都比較基礎,不容易出現將其部署到設備上時卻發現設備不支持一些剛開發出來的 operator 的問題,如果使用 Tensorflow-Lite 等 framework 的話最終的需要運行 binary 也足夠小,方便通過云端對設備進行遠程更新。

至少在智能識別雜草模塊上,如何獲得更高質量的數據、如何快速迭代是比用什么神經網絡重要的多的問題。一般來說,像這樣標定在特定領域(domain specific)的產品,往往都是從一個很小的數據集起步直接訓練模型,然后在自己的或者合作方的場地進行測試。如果產品的表現差強人意就可以部署到 edge device ,并建立相關的控制系統,來進行更大范圍的測試。當在測試過程中發現問題時——比如異地測試發現模型不能識別當地的特殊雜草——再通過重新訓練模型來優化產品表現。因此,如何在噴灑機器測試后,再高效地重新訓練模型,這種關系到 AI 落地的問題,則是筆者在本文想主要討論的問題。

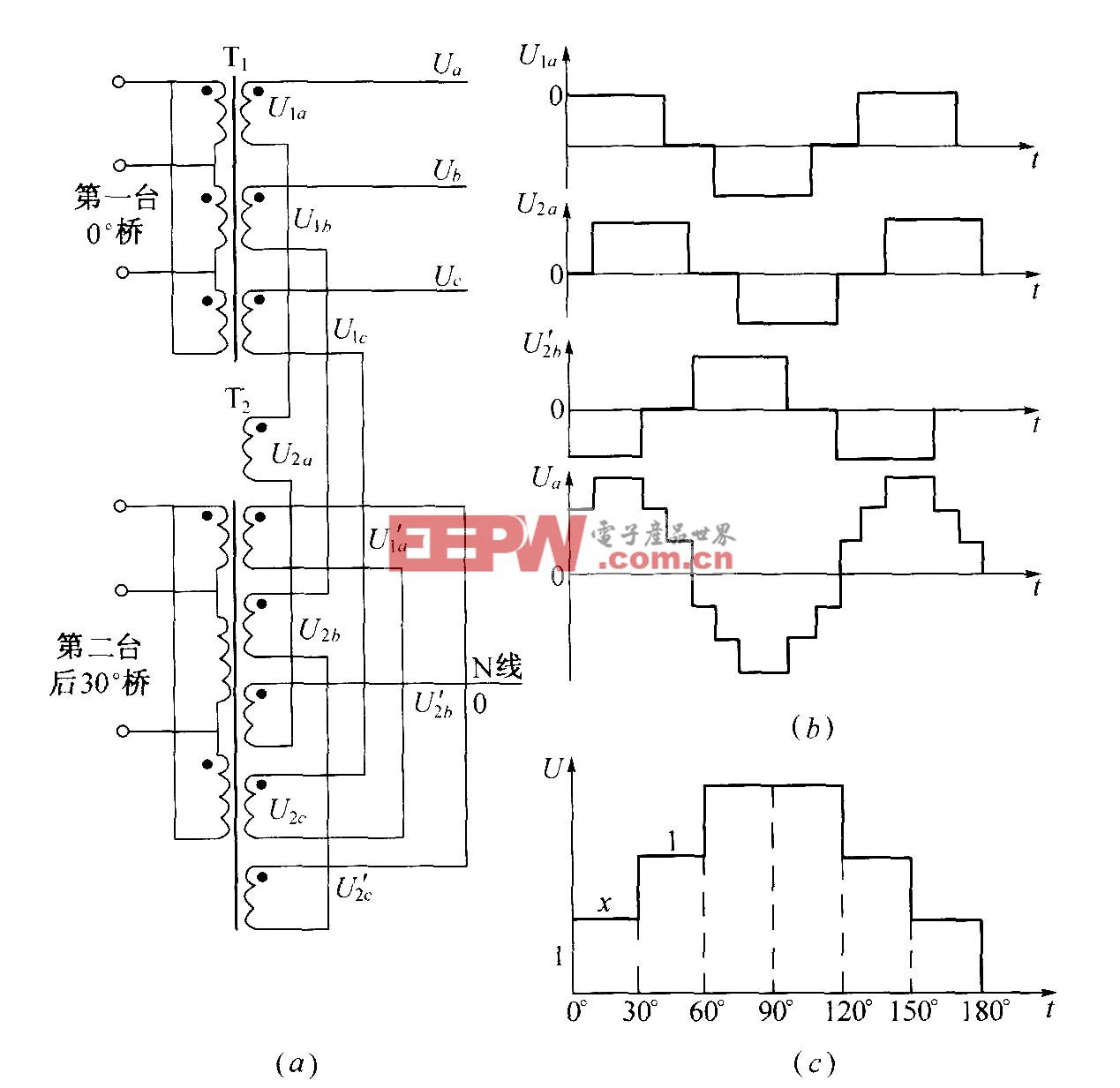

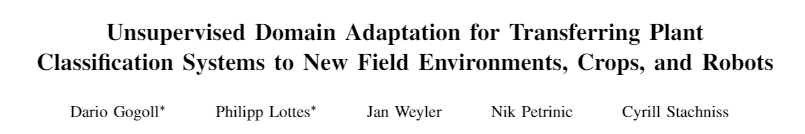

在過去不久的 IROS 2020 會議上,波恩大學的團隊提出了使用 Style Transfer 生成數據來用于重新訓練模型而不必再收集數據 [3]。作者將已經收集并標記好的數據領域命名為源領域(source domain),神經網絡需要重新訓練的數據領域命名為目標領域(target domain)。源領域和目標領域區別可以在于雜草的不同、環境的不同(黃土地 VS 黑土地)、相機的不同等等等等。

用于語義分割 (semantic segmentation)的全卷積神經網絡(FCN)就是前文提到的 UNet,具體結構如下文所示。

用于進行圖像分割的 FCN 神經網絡(圖源:Gogoll, D. et al. (2020). Unsupervised Domain Adaptation for Transferring Plant Classification Systems to New Field Environments, Crops, and Robots. 2020 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS).)

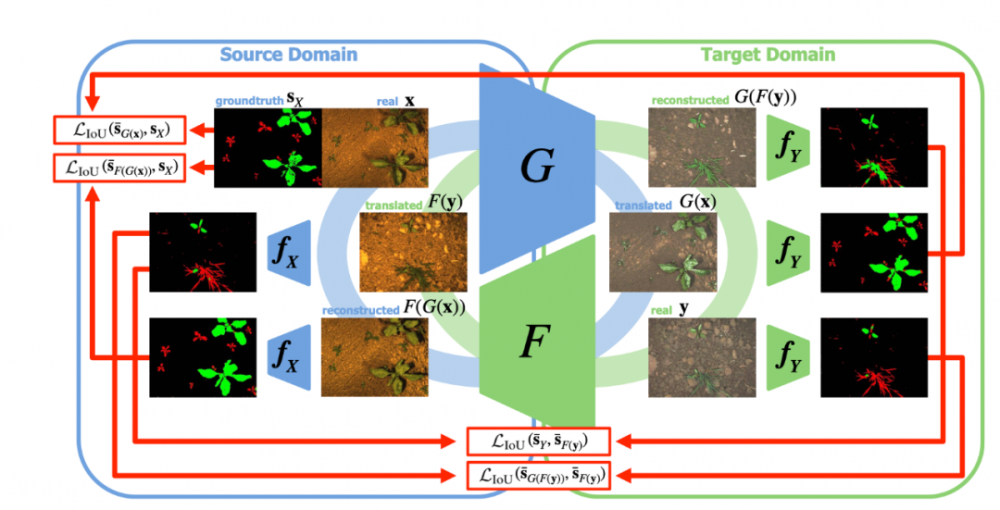

在目標領域內,由于數據已經被標記好,直接使用有監督訓練就可以得到可用模型。當該模型被用于其他環境時,由于數據領域的變化,模型表現會下降,此時,作者使用 Cycle GAN 來將原有的數據轉化為符合目標領域風格的數據。Cycle GAN 由兩個生成器(genrators )G 和 F 組成。G 用于將圖像從源領域轉換到目標領域,F 則做反方向的轉換。

假設在源領域內已有圖像 x 和 Groundtruth S_x,在目標領域內有圖像 y 但沒有相應 groundtruth。則 Cycle GAN 中的生成器 G 會將圖像 x 轉換到目標領域生成 G(x),F 再將 G(x) 轉換回源領域生成 F(G(x)),如下圖藍色圓環所示。接下來的循環中——如綠色圓環所示——生成器 F 將目標領域的圖像 y 轉換成 F(y),再有 G 轉換回目標領域生成 G(F(y))。訓練時使用的損失函數是 Cycle GAN 論文中原本使用的損失函數。

用于生成仿真圖像的 Cycle GAN(圖源:Gogoll, D. et al. (2020). Unsupervised Domain Adaptation for Transferring Plant Classification Systems to New Field Environments, Crops, and Robots. 2020 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS).)

這樣訓練雖然可以保證生成的圖像和目標領域的圖像具有一樣的風格,卻不能保證圖像中重要的語意信息還能被保留下來。但如果沒有語意信息,生成的圖像就不能用于重新訓練神經網絡,整個工作也就毫無意義。為了解決這個問題,作者在兩個領域內各加了一個用于圖像分割的 FCN,結構和前文提到的 FCN 一模一樣。在每個循環中,FCNs 需要對生成的圖像進行分割,并與 groundtruth 對比計算 IOU 損失。由于目標領域內的圖像 y 沒有 groundtruth,源領域內 FCN f_x 在其上的預測結果 S_{F(y)} 將作為 grouthtruth。這樣,在源領域內可以計算 FCN 對生成器 F 生成的圖像 F(G(x)) 的預測 vs groundtruth S_y 的 IOU 損失;在目標領域內可以計算三個 IOU 損失,FCN 對生成器 G 生成的圖像 G(F(y)) 的預測 vs S_{F(y)}、對生成的 G(x) 的預測 vs groundtruth S_y、 以及對圖像 y 的預測 vs S_{F(y)}。

這些損失將被記入到損失函數中,以保證生成的圖像仍保有重要的語意信息。

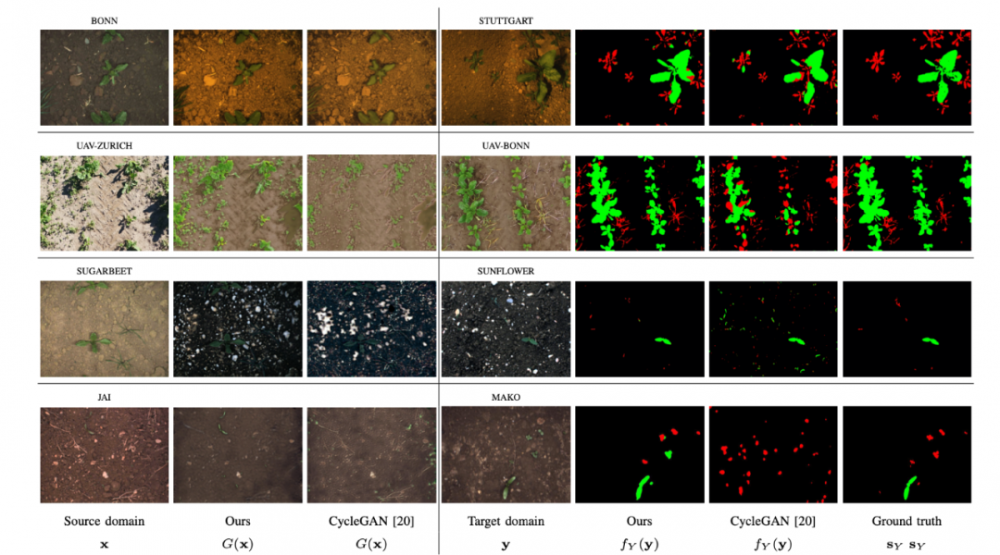

在下圖中,作者展示了將 IOU 損失納入目標損失函數所帶來的效果,其中第一行和第二行代表了在不同地域收集數據所帶來的數據變化(波恩 vs 斯圖加特,蘇黎世 vs 波恩),第三行實驗了不同作物(甜菜 vs 太陽花),第四行則使用了不同的機器人,其上配備的相機不同(AD-130GE vs MAKO G-158)。除了第三行部分使用了太陽花數據,其他數據都是基于甜菜的,目標則是識別圖中的雜草。從這里也可以一窺一旦地域擴大、時間拉長,雜草檢測任務的復雜度也直線上升。

在前兩行中,視覺上來看原本的 CycleGAN 雖然比不上作者改進的 GAN,但還不算太差。但當圖像變得比較「稀疏」,特別是作物和雜草都變得很小時, CycleGAN 生成的圖像就開始丟失很多語意信息,大大拉低了圖像質量。由此導致重新訓練后的 FCN 在預測時丟掉了很多細節,噪聲也比較多。

定性結果。第一行和第二行:不同地點;第三行:不同作物;第四行:不同鏡頭 / 機器人收集的數據。(圖源:Gogoll, D. et al. (2020). Unsupervised Domain Adaptation for Transferring Plant Classification Systems to New Field Environments, Crops, and Robots. 2020 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS).)

其他簡單的方法還有直接將各種雜草「摳圖」,然后拼接到此前拍攝的圖片上,從而對需要重點關注的雜草進行訓練。由于這類圖片本身也是對著地面拍攝,景深并不復雜,拼接后的逼真度也是可以接受的。

田野機器人(field robot)

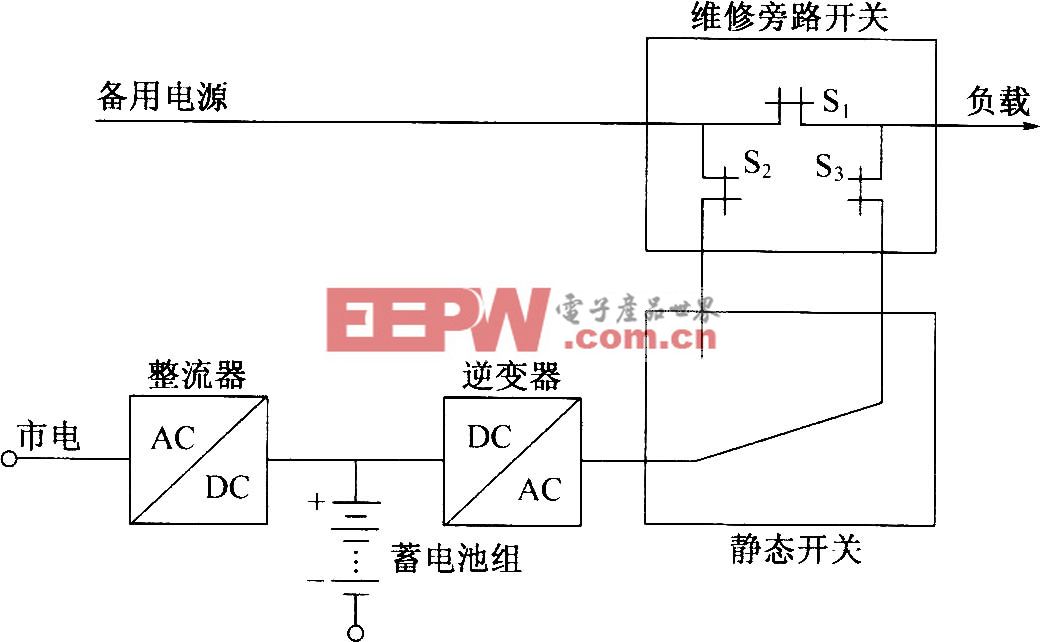

在 VDI Land.TECHNIK 2020 會議上,ecoRobotix 分享了他們研發田野機器人用于全自動智能噴灑作業的經驗 [2]。在產品還處于構思階段時,ecoRobotix 主要考慮了動力系統、圖像獲取、機器人運輸和安全問題。在設計動力系統時,一方面目前對清潔能源的要求越來越高,另一方面田野機器人作業的一大優勢就是不需人力,如果在實際作業時需要人力時不時對動力系統進行維護這一優勢就大打折扣了,所以 ecoRobotix 最終選擇了電池加太陽能版的解決方案。圖像獲取方面,光譜圖像(spectral image)相較于普通的 RGB 圖像更有優勢,但出于成本和訓練神經網絡的難易度等考慮,跟目前市面上的大部分解決方案一樣,最終 ecoRobotix 還是使用 了 RGB 圖像。實際對于智能噴灑這一任務來講, RGB 圖像就夠了,成本也更低。但如果是檢查作物健康,光譜圖像就變得有些不可取代了,因為很多作物損失在可見光下是不可見的。執行任務時機器人需要到田野作業,而機器人又不能自主上路,因此最終的產品需要容易被運送。也就是說,機器人最好不需要過多的其他附件來執行任務,并且的形態設計上要容易被拖拽。這樣可以通過拖拉機直接拖掛,然后運輸到目的地。安全性則主要指的是大小和重量,特別是在目前相關的法律法規還不清晰的情況下,越輕、越小的機器越容易規避可能的風險。同時這對產品最終的成本也有很大的影響。

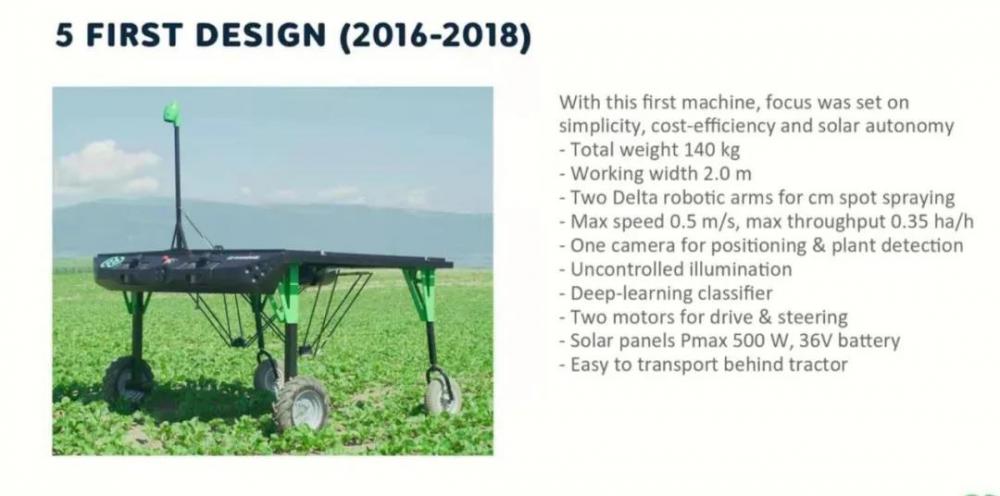

在 ecoRobotix 的第一版設計中,如下圖所示,整個機器人的重量只有 140 千克。為了將重量和成本壓得盡量低,整個機器人的設計非常簡單,基本上可以理解為在四個輪子上架了電池和一塊太陽能板,并在太陽能板旁邊安裝了算力設備、兩個噴嘴和控制系統以及一個相機。

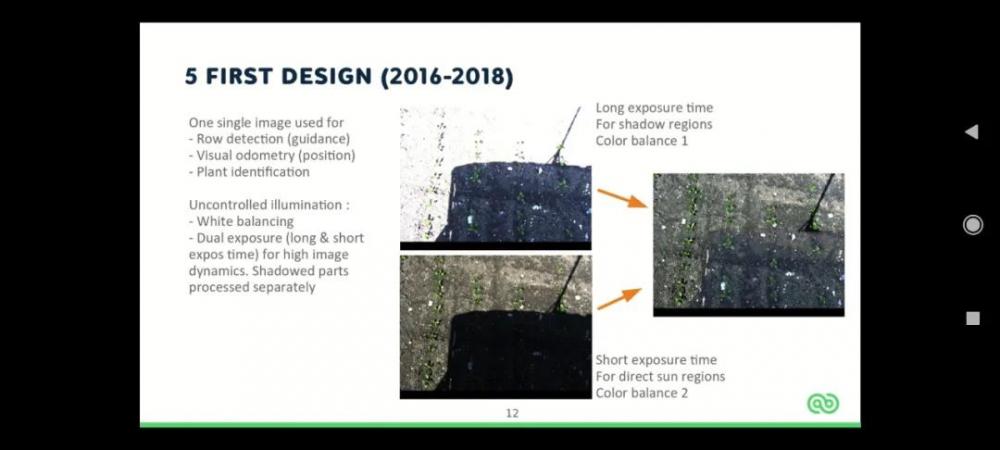

ecoRobotix 機器人第一版設計。(圖源:Tanner, S. (2020). Experience gained in developing autonomous robots. International Conference on Agricultural Engineering.)

雖然成本很低,但該機器人的工作效率實在不高—— 一次只能噴灑 2 米內的雜草,工作速度最高也只有 1.8 km/h。更麻煩的是,在第一版的設計中機身上的相機在捕捉圖像時主要依賴自然光,這就導致隨著地形、天氣和時間的變化獲取的圖像的質量會發生很大變化。即便通過曝光時長的不同相機能夠分別對陰影處和太陽光直射的地方進行拍攝(如下圖所示),最終合成的圖像質量仍然不理想。

ecoRobotix 第一版機器人拍攝圖像對于自然光不穩健。(圖源:Tanner, S. (2020). Experience gained in developing autonomous robots. International Conference on Agricultural Engineering.)

由于這個問題的存在,ecoRobotix 對其機器人進行了重新設計,最終形成的第二版配有更多部件,當然也更大更重(凈重 600 千克)。具體來說,第二版的機器人除了用太陽能版充當一個「頂棚」,還在旁邊安裝了擋板以阻擋自然光。相機則被安裝在擋板下方,并配有照明系統來獲取更穩定的亮度。相機的數量也增加到了兩臺,實時進行定位和雜草檢測。在機器人的尾部布有高密度的噴嘴(25 噴嘴 / 米),從而保證厘米級精度的噴灑作業。在作業速度方面,雖然還是算不上理想,但作業速度也有提升一倍(3.6 km/h)。由于機器人可以 24/7 全天不停歇作業,也在一定程度上彌補了其工作速度過慢的缺陷。

ecoRobotix 機器人第二版設計。(圖源:Tanner, S. (2020). Experience gained in developing autonomous robots. International Conference on Agricultural Engineering.)

無人機

在無人機方面,由于現有的解決方案基本都是由商業公司自行開發的,很難找到如論文等具體的演示,但其模型原理不能猜想——無人機也需要對其捕捉的圖像進行推理,并借助一些 GPS 軟件對預測到的雜草進行定位,然后或直接進行噴灑,或在飛行完畢后生成報告,用戶則可以將報告同步到自己的噴霧器中按規劃好的路徑進行噴灑。單純使用無人機進行智能噴灑相比其他方法并沒有很大優勢,但考慮到無人機還可以進行其他植保作業——如噴灑營養液、作物健康檢查等——用無人機進行智能噴灑就變得順理成章了起來。

目前市場上不同的服務商的賣點不同。American Robotics 致力于提供可以完全自主操作的無人機 [4]。通過將偵察無人機安置在 ScoutBase 中,無人機可以自行返回 ScoutBase 進行充電或躲避惡劣天氣。無人機本身并不執行任何實際作業,它們的任務只是偵察。ScoutBase 中還配有數據處理站,用于存儲、清洗、計算、傳送無人機獲取的數據。用戶只需要安裝 ScoutView 就可以連接到 ScoutBase 隨時獲取想要的數據。根據這些數據,用戶可以相應的安排噴灑工作。同樣采取這一策略的還有 Volodrone [5] ,但它們的無人機仍然需要操作人員。Skyx [6] 則致力于飛行和作業一體化和高度定制化。Skyx 的無人機可以在檢測到雜草的同時就噴灑除草劑,用戶可以通過 APP 隨時改變自己想要噴灑的****物量。相同類型的產品還有 DroneAG [7]。

結語

無人機的優點在于其靈活性,邊邊角角也能噴灑到,在不規則的農田里有優勢。但其工作效率實在難以恭維,即使目前市面上的植保無人機的單機載重和續航能力相較以前已經大大增加了。從燃料消耗比來看,噴灑效率最高的無疑是傳統的噴霧器,一次可以噴灑幾十米,駕駛速度也快,機器人和無人機難以望其項背。在大型農場里如果單純使用小型機器人,雜草的生長速度可以比噴灑完整個農田的速度還快。從無人化角度來看,相對于機器人和無人機,噴霧器的無人化進展更緩慢。機器人如果配有太陽能電池可以 24/7 工作,可以彌補噴灑效率低的缺陷。不需要操作人員的無人機在前文中已經提到了。

成本方面,三種產品不相上下。但噴霧器是市場上已經存在了很久的產品,其使用和維護都更容易上手。另一方面,由于體型和重量都更小,無人機和機器人在安全性上則占有巨大優勢,這在目前相關法律法規還沒有到位的情況下有助于規避可能的風險。

最后從環保角度來看的話,使用太陽能為無人機和機器人供能不是什么難題。但用清潔能源為噴霧器這類大型器械供能仍算小眾,雖然目前各大生產商都在加緊研制更環保的機器,市場上的大部分產品仍然在使用柴油。

對于消費者來說,目前農業市場還處在轉型過程中,不少農民對自動化解決方案還有顧慮,或認為其耐用性不足、或認為其用戶體驗不夠好、或認為其成本過高。另外,相關的法律法規也不夠明確,一旦出現事故,相關方如何定責是個難題。服務商如何處理其收集的數據、如何保護用戶的隱私等,都是農民密切關注的話題。但智能噴灑可以將化學產品的使用量減少至多 90%,從這一點來看不論目前的產品還有多少不足,智能噴灑產品進入這個行業并逐步成為被農民們接受的解決方案是必然的。

而技術的飛速發展,也在推動政府和相關機構更加積極的去探討監管機制。從筆者今年參加的各類會議來看,目前企業方研發人員都認為相關技術已經成熟,目前主要是在等待具體法規的發布。實際上,大部分從業者已經對將會出臺的監管內容有一個比較明確的預期了,并認為幾年內具體的條款就會發布。法規發布后,一到兩年之內相關產品就能夠完成準備工作進入市場了。隨之而來的,產品的成本也一定會很快的降低到農民可以接受的程度。

自動化技術正在滲透進我們生活的方方面面,而改變,很可能會比很多人想象中來的還要快。

參考文獻

[1] European Crop Protection Association(ECPA) https://www.ecpa.eu/more-with-less

[2] Tanner, S. (2020). Experience gained in developing autonomous robots. International Conference on Agricultural Engineering.

[3] Gogoll, D. et al. (2020). Unsupervised Domain Adaptation for Transferring Plant Classification Systems to New Field Environments, Crops, and Robots. 2020 IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS).

[4] https://www.american-robotics.com

[5] https://www.volocopter.com/en/volodrone/

[6] https://www.skyx.solutions

[7] https://droneag.farm

*博客內容為網友個人發布,僅代表博主個人觀點,如有侵權請聯系工作人員刪除。