OpenAI Atlas 瀏覽器漏洞允許惡意代碼注入 ChatGPT

OpenAI Atlas 瀏覽器漏洞詳情

OpenAI 新推出的 ChatGPT Atlas 瀏覽器存在一項嚴重漏洞,攻擊者可借此向 ChatGPT 的內存中注入惡意指令,并在用戶系統上執行遠程代碼。

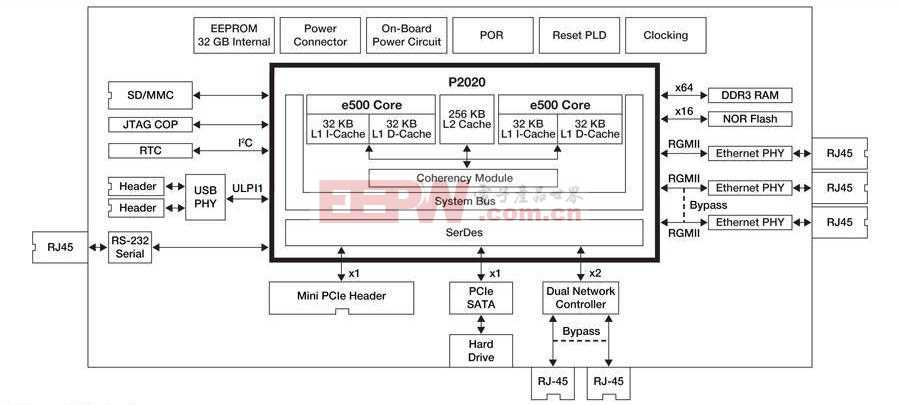

該漏洞由 LayerX 發現,利用跨站請求偽造(CSRF)技術劫持已驗證會話,可能導致設備感染惡意軟件或被未授權訪問。這一發現凸顯了智能體化 AI 瀏覽器的風險升級 —— 集成的大語言模型(LLM)會放大傳統網絡威脅。

該漏洞已通過負責任披露協議告知 OpenAI,所有瀏覽器環境中的 ChatGPT 用戶均受影響,但 Atlas 用戶面臨的風險更高。原因在于其持續在線的驗證機制和薄弱的釣魚防護能力。

LayerX 的測試顯示,Atlas 僅能攔截 5.8% 的釣魚攻擊,而 Chrome 和 Edge 的攔截率為 47% 至 53%,這使得 Atlas 用戶的暴露風險最高可達 90%。盡管 OpenAI 尚未公開補丁細節,但專家呼吁立即采取緩解措施,例如加強令牌驗證。

CSRF 如何針對 ChatGPT 內存攻擊

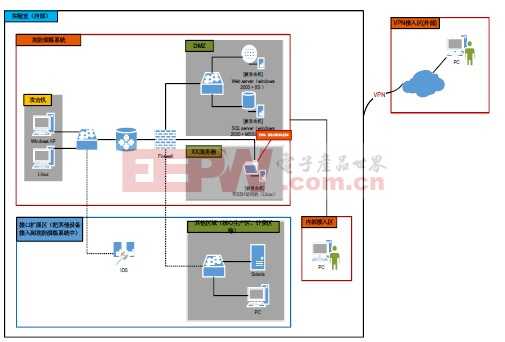

攻擊的前提是用戶已登錄 ChatGPT,且瀏覽器中存儲了驗證 Cookie 或令牌。攻擊者通過釣魚鏈接誘使受害者訪問惡意網頁,該網頁隨后利用現有會話發起 CSRF 請求。

這一偽造請求會向 ChatGPT 的 記憶功能注入隱藏指令。該功能的設計初衷是保留用戶偏好和會話上下文,避免用戶重復輸入。

與未授權交易等標準 CSRF 攻擊后果不同,這種變體攻擊通過污染大語言模型的持久化 “潛意識” 來針對 AI 系統。

惡意指令嵌入后,會在用戶發起合法查詢時激活,迫使 ChatGPT 生成有害輸出 —— 例如從攻擊者控制的服務器獲取遠程代碼。這種感染會在該賬號關聯的所有設備和瀏覽器中持續存在,增加了檢測和修復的難度。

Atlas 默認自動登錄 ChatGPT 的機制使憑證隨時可用,無需額外的令牌釣魚步驟,從而簡化了 CSRF 攻擊的實施。

LayerX 在 103 起真實攻擊場景中對 Atlas 進行了測試,發現 94.2% 的攻擊均成功得逞,遠遜于同類產品 —— 例如此前測試中 Perplexity 的 Comet 瀏覽器失敗率為 93%。這一結果源于 Atlas 缺乏內置防護機制,使其成為提示注入等 AI 專屬威脅的主要傳播載體。

更廣泛的研究也印證了這一擔憂:Brave 對包括 Atlas 在內的 AI 瀏覽器的分析發現,存在通過網頁或截圖嵌入指令的間接提示注入攻擊,可能導致數據泄露或未授權操作。

OpenAI 的代理功能允許自主任務,由于授予人工智能對用戶數據和系統的決策權而加劇了風險。

概念驗證:惡意 vibe 編碼

在一個演示場景中,攻擊者針對 vibe 編碼發起攻擊。這種編程模式下,開發者與 AI 協作聚焦于高層級的項目意圖,而非嚴格的語法規則。

注入的內存指令會巧妙篡改 AI 輸出,在生成的腳本中嵌入后門或數據泄露代碼 —— 例如從 “server.rapture” 等服務器下載惡意軟件。

ChatGPT 可能會發出微弱警告,但復雜的偽裝技術通常能規避這些警告,使受污染的代碼無縫交付。用戶下載此類腳本后,其系統可能被入侵,這也凸顯了 AI 的靈活性可能被濫用的風險。

該概念驗證與 Gemini 等工具中新興的漏洞一致,其中類似的注入會訪問共享的公司數據。

隨著 AI 瀏覽器的普及,此類漏洞需要超越基礎瀏覽器技術的強效防護措施。企業應優先采用具備可見性的第三方擴展程序,用戶則應啟用多因素認證并監控會話狀態。

LayerX 的研究結果表明,若不及時更新修復,Atlas 可能會重新定義 AI 安全的典型陷阱。

評論