“小顯存,大模型”國數集聯解讀如何降低AI普惠門檻

當行業普遍在為部署一套千億參數大模型而堆砌數百GB HBM顯存、配置多臺高端GPU服務器時,一個更現實的問題擺在中小企業面前:如何在有限預算內,安全、高效地本地化運行這些模型?國數集聯嘗試從“運力”的角度給出方案——用更經濟的DDR內存和CXL互聯技術,緩解對昂貴顯存的依賴,讓“小顯存”也能跑起“大模型”。

一、行業背景:大模型與中小企業之間的“顯存墻”

當前,大模型的參數規模已從千億向萬億邁進,而單張GPU的顯存容量卻受物理工藝、成本限制,增長相對緩慢。如果要完整容納一個DeepSeek 671B(FP8需約700GB)或Qwen3 235B(FP8需約280GB),仍需多卡并行、顯存疊加的方式實現,這直接推高了大模型本地化部署的硬件門檻。

對于大多數中小企業而言,開源模型的獲取已不是問題,真正的障礙在于基礎設施成本。一套支持千億模型推理的傳統方案,通常需要8卡甚至16卡高端專用顯卡,硬件投入動輒數百萬元,加上散熱、運維等后續開支,遠超中小企業的承受范圍。這也意味著,盡管大模型能力強大,但大量企業仍被擋在本地化部署的門外,不得不依賴云端API,進而面臨數據隱私泄露、推理延遲較高、長期租賃成本疊加等問題。

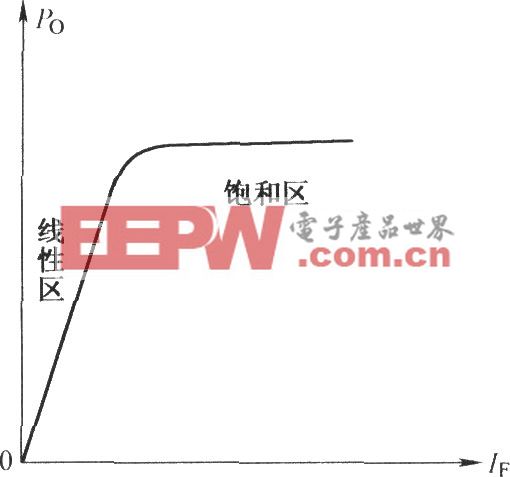

其主要問題在于模型參數總量與GPU物理顯存容量之間有差距。而單純堆砌顯存的線性擴展模式,不僅成本居高不下,且靈活性極差。國數集聯提出的思路是,基于模型MOE(混合專家)架構,不追求將所有參數常駐GPU顯存,而是通過異構內存分層管理,讓GPU專注于核心計算任務,讓大容量DDR或CXL內存池來承擔相關職責。這套“小顯存、大模型”方案,正是針對這一矛盾的靈活性解法,尤其適合對成本敏感、對數據隱私要求高的邊緣端場景和中小企業。

二、實現方案:精準卸載與CXL技術協同,打破顯存天花板

所謂“小顯存”,是一個相對概念 —— 當GPU的物理顯存容量,小于待運行模型的參數總量與KV Cache之和時,就需要借助外部存儲資源來彌補。國數集聯的思路是基于CPU/KVCache卸載機制,并結合CXL內存池化技術,實現“隱形顯存”的高效擴展,即降低硬件成本,又保障必要的推理性能。

CPU Offload解決參數容量瓶頸。

在傳統Dense大模型推理中,整個模型的全部參數需常駐GPU顯存,以便隨時調用。但當模型參數接近或超過顯存容量時,模型無法完成啟動。國數集聯利用MOE模型的特性,將完整模型參數存放于CPU側的大容量DDR內存(或未來的CXL內存池)中,GPU僅保留當前計算層所需的“活躍專家”參數,計算完成后立即將該部分參數換出,下一層所需的“活躍專家”參數再從CPU側內存中換入。這一過程由軟件調度與硬件指令集協同完成,盡可能減少數據搬運帶來的延遲與性能損失。

去年,國數集聯已基于SGLang框架完成技術驗證:在一張24GB顯存的GPU上,配合1024GB DDR內存,實現了4路并發、流暢運行DeepSeek 671B FP8版本,推理速度達到28 tokens/s。截至目前,方案已升級擴展,可支持Qwen系列等主流開源MOE大模型,適配多卡場景,GPU顯存可從單卡24GB靈活升級至48GB、96GB甚至更高,DDR內存容量也可按需調整。企業可根據業務增長逐步擴容,無需一次性投入全部硬件成本。

KV Cache Offload解決并發和長上下文瓶頸。

在生成式AI任務中,KV Cache會隨對話長度線性增長,占用大量GPU顯存,嚴重限制多路并發能力。國數集聯將KV Cache數據卸載到CPU側內存池中管理,釋放GPU顯存空間,讓其專注于核心計算任務。這一優化,使得在單卡上同時運行多個并發成為可能。

CXL技術的引入,從臨時卸載到內存池化。

當前方案中,CPU側使用的DDR內存仍受限于本地總線帶寬和容量上限,難以滿足未來更大規模模型的部署需求。隨著CXL生態成熟,國數集聯正將CXL內存池化技術引入架構升級,實現從“臨時卸載”到“常態化內存分層管理”的跨越。

CXL技術的核心優勢的在于,允許CPU、GPU、AI加速器等不同設備共享一致的內存空間,并支持內存的靈活擴展和池化管理。未來GPU可直接訪問由CXL交換機連接的遠端大容量的內存池。如同訪問本地內存一樣,但內存容量可擴展至TB級別,帶寬也隨著CXL 3.x/4.0的部署而提升。

這種架構下,卸載不再是權宜之計,而是一種常態化的內存分層管理:熱數據(當前活躍參數、高頻訪問的KV Cache)留在GPU近端顯存,溫數據(完整參數、低頻Cache)置于CXL內存池,冷數據甚至可進一步下沉到CXL SSD。通過這種分層管理,實現性能、成本與靈活性的最佳平衡,為后續更大規模模型的低成本部署奠定基礎。。

三、核心價值:低成本、高靈活、易部署,讓AI普惠落地

國數集聯“小顯存、大模型”方案,對中小企業AI本地化應用的價值是多維度的,不僅大幅降低硬件采購成本,更在部署靈活性、運維簡便性上實現優化,真正讓AI技術能夠走進更多中小企業。

成本大幅降低:相比傳統的堆卡方案,國數集聯“小顯存”方案可將硬件成本降低60%以上。企業可使用消費級顯卡(如RTX 4090 24GB)起步,配合大容量DDR內存,即可運行百億甚至千億模型。盡管在并發性能上與高端多卡方案還有差距,但對于要求不高的場景,性價比極高。

部署靈活,可按需擴展:企業無需一次性投入全部硬件成本,可從一臺配備單卡的工作站開始,后續隨業務增長逐步增加顯卡、內存,或接入CXL內存池,無需推翻原有架構。這種漸進式投資模式,降低了中小企業的初始投入壓力,也讓AI能力的獲取更加平滑。

場景適配廣泛,隱私更有保障:方案特別適合邊緣和中小企業本地化部署場景。在生產企業,可用于產線質檢模型實時推理;在電商行業,可支撐智能客服、商品描述自動生成;在外貿領域,可實現郵件自動回復、多語言翻譯;在金融行業,可用于合同審核、簡單風險分析;在教科研領域,可滿足教學演示、學術研究的算力需求。同時,本地化部署模式避免了數據上傳云端,從源頭保障數據隱私安全,規避云端服務的延遲風險和長期租賃成本。

運維簡便,降低技術門檻:方案基于單卡或少量顯卡的架構,系統結構簡單,故障點少,無需專業的高端運維團隊,更適配中小企業IT團隊規模有限的現狀。此外,國數集聯還提供了優化后的軟件棧,集成ComfyUI文生圖/視頻、圖生圖/視頻等主流智能體應用,用戶可實現“開箱即用”,無需投入大量精力進行軟件適配和調試,專注于業務創新而非基礎設施維護。

四、未來演進:從單點優化到基于CXL的異構資源池

從2025年開始,CXL技術正從概念走向規模化落地,國內外廠商紛紛推出相關產品和方案。例如,英偉達通過收購Enfabrica,推出基于CXL的Emfasys 144T內存集群,優化大規模AI推理的彈性內存架構;Google計劃在下一代TPU中采用CXL內存池化,替代或補充HBM;Marvell推出Structera系列產品,實現與主流內存及CPU平臺的高效互操作;阿里云則在PolarDB數據庫服務器中引入CXL技術,顯著提升內存交互性能并降低總體擁有成本(TCO)。

國數集聯將沿著“普惠”路徑持續深化方案,短期目標包括:進一步優化參數卸載策略和調度算法,支持更多模型,同時提升推理吞吐量和響應速度。推出基于CXL的擴展卡和內存池設備,實現從單服務器擴展至多臺邊緣設備共享內存資源的跨越,提升資源利用率。此外,國數集聯還在探索與UAlink等新一代高速互聯技術的融合,構建更高效、更靈活的異構計算平臺。

長期來看,隨著CXL 3.X及后續版本的普及,真正的異構資源池將成為現實。屆時,不僅內存,不同計算單元(GPU、NPU、FPGA)也能被靈活組合,企業可按需從池中調用算力與內存資源,如同使用水電一樣便捷。資源配置將極度靈活,可按任務需求動態調整,實現資源利用率和性價比的最大化。同時,該架構為“存算分離”等新一代高效模型架構提供了原生硬件支持,持續降低單位AI能力的獲取成本。

五、結論

國數集聯的“小顯存、大模型”之路,始于一個樸素的問題:如何用更低的成本,讓大模型安全可靠地運行在本地?通過CPU/KVCache Offload與CXL技術的協同創新,他們給出了一個切實可行的方案。這套方案并未試圖發明比GPU更快的計算硬件,而是通過“運力”架構的創新,讓現有GPU在顯存受限的條件下釋放最大潛力。

未來,隨著CXL等高速互聯技術的不斷演進,AI基礎設施的門檻有望進一步降低,普惠AI的愿景將更加接近現實。國數集聯始終認為,衡量技術先進性的最終標準,不是參數的堆砌,也不是硬件的奢華,而是能否讓更多企業和個人真正用上、用好AI技術。讓AI成為推動中小企業數字化轉型、賦能實體經濟的核心動力。

![[Android開發視頻教學]XML文件解析(20)](http://editerupload.eepw.com.cn/201010/eb418fc9480bcea449ae08ec493a7795.jpg)

![[Android開發視頻教學]文件下載(18)](http://editerupload.eepw.com.cn/201010/1cb9881533ef9443d97dc579762a9f8f.jpg)

![[Android開發視頻教學]廣播機制(二)(22)](http://editerupload.eepw.com.cn/201010/3d5d8c2910a15f174a8a3d7d21969de5.jpg)

![[Android開發視頻教學]ContentProvider初步(19)](http://editerupload.eepw.com.cn/201010/b03820209071d2a82c2d4064aea3b746.jpg)

![[Android開發視頻教學]廣播機制(一)(21)](http://editerupload.eepw.com.cn/201010/a160804e52e2b550307697372948a83a.jpg)

評論