英偉達攜手合作伙伴將在變電站旁建微型數據中心

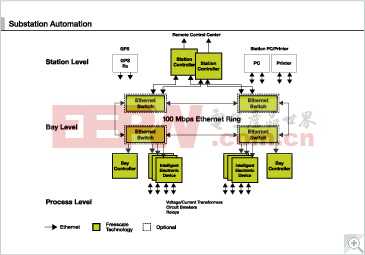

AI 數據中心耗電量激增,行業開始想方設法解決供電難題。最新方案是:在變電站旁邊建微型數據中心,根據電網負荷動態調度算力。

英偉達與合作伙伴計劃在今年下半年啟動試點:在美國 5 家公用事業公司范圍內,共建25 個微型數據中心,單站功率 5–20 兆瓦。某變電站負荷過高或斷電時,算力自動遷移到供電充裕的鄰近站點。

合作方包括:數據中心建設商 InfraPartners、地產服務商 Prologis、電力研究機構 EPR(原電力研究院)。

項目目標

驗證彈性算力 + 電網協同新模式,快速獲取電網零散富余電力 —— 這在當下愈發珍貴。

EPRI 智能 AI 架構主管 Ben Sooter:“單個變電站富余功率約 5 兆瓦、最高 20 兆瓦,規模太小難建傳統數據中心,但多個微站協同就能湊成可用算力,還能把電網可用容量翻倍。美國約 5.5 萬座變電站,富余電力總量驚人。”

英偉達能源高級總監 Marc Spieler:“AI 推理負荷可隨電走,是大勢所趨。”

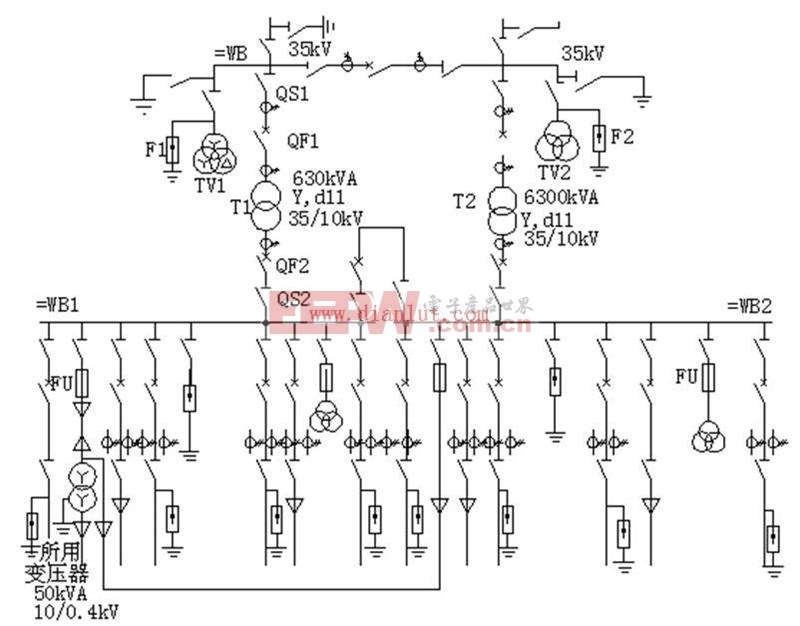

電網困局與解法

數據中心用電激增:預計 2030 年美國數據中心耗電占全國9%–17%,較現在翻倍。AI 訓練中心能耗達吉瓦級,堪比中型城市。

傳統方案周期長、成本高:

電網擴容審批可達十年;

自建燃氣電廠、投資核聚變、修高壓線路。

新機會:美國電網平均利用率僅 53%,尖峰負荷(年 < 200 小時)之外,大量電力閑置。

尼古拉斯研究所測算:數據中心僅 0.25% 時間限電,即可釋放76 吉瓦富余電力(約峰值 10%)。

微站優勢

建設快:無需新建電廠,直接接入變電站現有線路;

成本低:復用變電站電網、光纖、配套設施;

彈性高:負荷動態遷移,適配推理類任務。

訓練 vs 推理:算力調度差異

AI 訓練:需要數萬 GPU 高速互聯(NVLink/InfiniBand),不可拆分;

AI 推理:單次請求、低延遲、可分布式調度。

Mod42 戰略副總裁 Valerie Crafton:“推理是唯一能‘跟著電走’的算力,這正是微型數據中心興起的原因。”

項目進展

英偉達 + EPRI 的分布式推理試點:2026 年底前開工,預計僅0.1% 時間需要遷移算力。

EPRI 的 Sooter:“第一輪算力浪潮是超大型數據中心(5 吉瓦級);第二輪是推理專用微型集群,2027 年推理需求將爆發。”

評論