AI PC方興未艾,而除了CPU、GPU、NPU這樣的基礎硬件,更關鍵的是應用軟件與場景的生態落地。只有從應用上真正改變人們的日常工作、生活體驗,帶來真正的便利,AI PC才能取得成功。作為行業執牛耳者,Intel不但率先倡導了AI PC的概念,帶來了史上變革最大的酷睿Ultra處理器、大量的AI PC筆記本,領導PC全面進入AI時代,更在生態拓展方面不遺余力地投入。按照Intel的宏圖大愿,AI PC 2024年的出貨量就會有大約4000萬臺,而到了2025,這一市場規模將超過1億臺,走進千家萬戶。為了

關鍵字:

Intel CPU GPU NPU

邊緣智能是人工智能的一種部署形式,無論中央人工智能,還是邊緣智能,都需要算力支撐。而集中和分布式計算呈現出相互促進和交替發展的趨勢。作為移動處理器領域市場的引領者,Arm 的各類處理器內核在邊緣端的MCU、NPU 和MPU 等領域引領著技術發展的未來。Arm物聯網事業部業務拓展副總裁 馬健談到邊緣智能,Arm 物聯網事業部業務拓展副總裁馬健表示,伴隨著Transformer與大模型的發展,AI模型的普適性、多模態支持,以及模型微調效率都有了質的突破,加上低功耗的AI 加速器和專用芯片被集成到終端和邊緣設備

關鍵字:

202405 Arm 邊緣AI 邊緣智能 NPU

人工智能芯片研發及基礎算力平臺公司愛芯元智宣布,近日,Meta、Microsoft相繼發布具有里程碑意義的Llama 3系列和Phi-3系列模型。為了進一步給開發者提供更多嘗鮮,愛芯元智的NPU工具鏈團隊迅速響應,已基于AX650N平臺完成 Llama 3 8B和Phi-3-mini模型適配。Llama 3上周五,Meta發布了Meta Llama 3系列語言模型(LLM),具體包括一個8B模型和一個70B模型在測試基準中,Llama 3模型的表現相當出色,在實用性和安全性評估中,與那些市面上流行的閉源模

關鍵字:

愛芯通元 NPU Llama 3 Phi-3 大模型

MCX N系列是高性能、低功耗微控制器,配備智能外設和加速器,可提供多任務功能和高能效。部分MCX N系列產品包含恩智浦面向機器學習應用的eIQ? Neutron神經處理單元(NPU)。低功耗高速緩存增強了系統性能,雙塊Flash存儲器和帶ECC檢測的RAM支持系統功能安全,提供了額外的保護和保證。這些安全MCU包含恩智浦EdgeLock?安全區域Core Profile,根據設計安全方法構建,提供具有不可變信任根和硬件加速加密的安全啟動。MCX N系列微型處理器:MCXN94xMCXN54x基

關鍵字:

NXP MCX NPU 微處理器

人工智能作為過去兩年以及未來幾年注定爆火熱點應用,始終缺乏足夠的落地方案確保盈利能力,即使目前最火爆的生成式AI(AIGC)依然屬于燒錢階段。因此,支撐AI未來商業價值的,并不只是人們看到的大模型和AIGC,還需要更多終端節點對人工智能應用的支持。 算力成本是人工智能應用中不可回避的話題,畢竟從算力開銷上來說,單純把所有計算都放在云端不僅帶來的是龐大的算力構建費用,更是因為大量數據的反復傳輸而帶來能效方面的開銷。因此,將算力資源合理的分配到云端和邊緣側可以更好地發揮不同節點的處理資源,將復雜AI推理和訓練

關鍵字:

MCU NPU Arm 物聯網 AI

AI浪潮正持續改變各行各業,此前歷經下行周期的PC市場也開始迎來新的機會。今年以來,無論是美國消費電子展(CES)還是巴塞羅那世界移動通信大會(MWC),AI

PC都成為了當之無愧的焦點,包括英特爾、AMD、英偉達等芯片大廠,以及聯想、戴爾、宏碁、華碩、榮耀等下游廠商紛紛推出相關產品,布局AI

PC。業界直言,2024年或是AI PC元年,這一風口下,半導體領域NPU以及存儲器等有望持續受益。一 AI PC一觸即發,半導體大廠瞄準NPUChatGPT的橫空出世,讓人見識到了AI大模型的威力,隨后,

關鍵字:

AI PC 存儲器 NPU

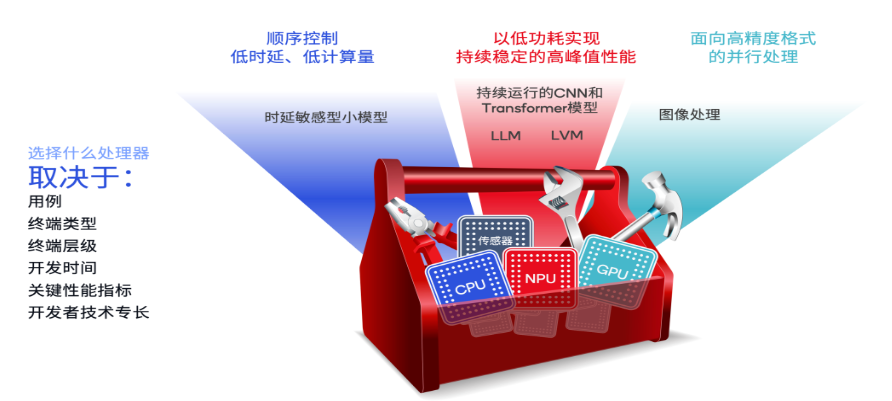

生成式AI變革已經到來。隨著生成式AI用例需求在有著多樣化要求和計算需求的垂直領域不斷增加,我們顯然需要專為AI定制設計的全新計算架構。這首先需要一個面向生成式AI全新設計的神經網絡處理器(NPU),同時要利用異構處理器組合,比如中央處理器(CPU)和圖形處理器(GPU)。通過結合NPU使用合適的處理器,異構計算能夠實現最佳應用性能、能效和電池續航,賦能全新增強的生成式AI體驗。正如在工具箱中選擇合適的工具一樣,選擇合適的處理器取決于諸多因素,將增強生成式AI體驗。異構計算的重要性生成式AI的多樣化要求和

關鍵字:

NPU AI 計算架構

芯原股份近日宣布集成了芯原神經網絡處理器(NPU)IP的人工智能(AI)類芯片已在全球范圍內出貨超過1億顆,主要應用于物聯網、可穿戴設備、智慧電視、智慧家居、安防監控、服務器、汽車電子、智能手機、平板電腦、智慧醫療等10個市場領域。在過去七年里,芯原在嵌入式AI/NPU領域全球領先,其NPU IP已被72家客戶用于上述市場領域的128款AI芯片中。芯原的NPU IP是一款高性能的AI處理器IP,采用了低功耗、可編程和可擴展的架構設計。它可以靈活配置,以滿足客戶對芯片尺寸和功耗的不同要求,使之成為具有成本效

關鍵字:

芯原 NPU IP AI芯片

2023年已落下帷幕,全球半導體市場在經歷了一年的波折之后,迎來了更加不確定的2024年。在這個關鍵時刻,安謀科技作為芯片供應鏈上游的核心企業,憑借敏銳的產業嗅覺和穩健的技術投入,持續賦能行業的創新發展。受訪人:趙永超(安謀科技智能物聯及汽車業務線負責人)?在2023年,安謀科技發布了“周易”X2 NPU和“山海”S20F SPU兩款自研業務新品,并與Arm聯合推出了智能視覺參考設計。這些產品和技術解決方案為新興市場提供了系統級、全棧式的支持,有力地推動了智能汽車、AIoT、移動終端、數據中心基

關鍵字:

安謀科技 NPU SPU 芯片IP

幫助智能邊緣設備更可靠、更高效地連接、感知和推斷數據的全球領先硅產品和軟件IP授權許可廠商Ceva公司(納斯達克股票代碼:CEVA) 宣布與兩家瞄準汽車和視覺邊緣人工智能(Edge AI)應用的新合作伙伴結盟,擴大業界領先的NeuPro-M NPU IP人工智能生態系統。?????? Ceva副總裁兼視覺業務部門總經理Ran Snir表示:“我們熱烈歡迎Visionary.ai和ENOT.ai加入支持智能邊緣客戶群的合作伙伴生態系統。這些合作伙伴

關鍵字:

Ceva NPU IP 人工智能 CES

IT之家?10 月 24 日消息,三星于今年 10 月 5 日在美國加州圣何塞舉辦的 System LSI 技術日活動中,正式宣布了 Exynos 2400 處理器,表示 CPU 性能要比 Exynos 2200 快 70%,AI 處理能力快 14.7 倍。國外科技媒體?Android?Headlines 近日分享了 Exynos 2400 處理器 NPU 芯片的更多細節。報告稱三星大幅優化了 NPU 芯片對非線性運算的支持,通過架構調整等優化手段,Exynos 2400 在

關鍵字:

三星 NPU SoC

●? ?Neo NPU可有效地處理來自任何主處理器的負載,單核可從 8 GOPS 擴展到 80 TOPS,多核可擴展到數百 TOPS●? ?AI IP可提供業界領先的 AI 性能和能效比,實現最佳 PPA 結果和性價比●? ?面向廣泛的設備端和邊緣應用,包括智能傳感器、物聯網、音頻/視覺、耳戴/可穿戴設備、移動視覺/語音 AI、AR/VR 和 ADAS●? ?全面、通用的 NeuroWeave SDK 可通過廣泛的 Caden

關鍵字:

Cadence Neo NPU IP NeuroWeave SDK

全球領先的無線連接、智能感知技術及定制SoC解決方案的授權許可廠商CEVA, Inc. (納斯達克股票代碼: CEVA)宣布推出增強型NeuPro-M NPU系列,以業界領先的性能和能效滿足下一代生成式人工智能(Generative AI)的處理需求,適用于從云端到邊緣的各類別的人工智能推理工作負載。NeuPro-M NPU架構和工具經過重新設計,除支持CNN和其他神經網絡外,還支持transformer網絡,并支持未來的機器學習推理模型,因而能夠在通信網關、光連接網絡、汽車、筆記本電腦和平板電腦、AR/

關鍵字:

CEVA NPU IP 生成式人工智能 Generative AI

中國 上海 2023年7月19日——愛芯元智宣布,企業核心技術混合精度NPU正式啟用中文名稱“愛芯通元?”。與此同時,愛芯元智聯合創始人、副總裁劉建偉在第三屆中國集成電路設計創新大會暨無錫IC應用博覽會(ICDIA 2023)的“AIoT與ChatGPT”專題論壇上,受邀做《愛芯元智AX650N Transformer端邊落地平臺》主題演講,并介紹了第三代SoC芯片AX650N在端側、邊緣側部署Transformer的領先優勢。 愛芯元智混合精度NPU中文名“愛芯通元?”正式公布近年來,AIoT

關鍵字:

愛芯元智 NPU 愛芯通元

近來,ChatGPT成為社會各界關注的焦點。從技術領域看,ChatGPT的爆發是深度學習領域演進、發展和突破的結果,其背后代表著Transformer結構下的大模型技術的飛速進展。因此,如何在端側、邊緣側高效部署Transformer也成為用戶選擇平臺的核心考量。2023年3月,愛芯元智推出了第三代高算力、高能效比的SoC芯片——AX650N,依托其在高性能、高精度、易部署、低功耗等方面的優異表現,AX650N受到越來越多有大模型部署需求用戶的青睞,并且先人一步成為Transformer端側、邊緣側落地平

關鍵字:

愛芯元智 Transformer NPU

coral npu介紹

您好,目前還沒有人創建詞條coral npu!

歡迎您創建該詞條,闡述對coral npu的理解,并與今后在此搜索coral npu的朋友們分享。

創建詞條

關于我們 -

廣告服務 -

企業會員服務 -

網站地圖 -

聯系我們 -

征稿 -

友情鏈接 -

手機EEPW

Copyright ?2000-2015 ELECTRONIC ENGINEERING & PRODUCT WORLD. All rights reserved.

《電子產品世界》雜志社 版權所有 北京東曉國際技術信息咨詢有限公司

京ICP備12027778號-2 北京市公安局備案:1101082052 京公網安備11010802012473