對于人工智能處理器初創(chuàng)企業(yè)來說,是否是成敗的關(guān)鍵時刻?

NVIDIA 的爆發(fā)式發(fā)展及其 GPU 引發(fā)的持續(xù)旺盛需求,推動了全球 AI 處理器領(lǐng)域的熱潮。然而,一眾專注研發(fā)專用 AI 芯片的初創(chuàng)企業(yè),其發(fā)展浪潮已迎來拐點,或正無限接近頂峰。

2016 年以來,全球 AI 處理器初創(chuàng)企業(yè)的數(shù)量已翻倍,截至 2025 年底,該領(lǐng)域獨立運營企業(yè)的數(shù)量激增至 146 家,這一規(guī)模已難以為繼。迄今為止,這些企業(yè)累計獲得 280 億美元的投資,投資者均被 AI 處理器市場的巨大前景所吸引。市場預(yù)估,2026 年 AI 處理器市場規(guī)模將突破 4940 億美元,其中硬件出貨量的增長主要由云端及本地 AI 推理、從可穿戴設(shè)備到個人電腦的邊緣端部署驅(qū)動,而市場營收的增長則主要依托 AI 訓(xùn)練業(yè)務(wù)及超大規(guī)模數(shù)據(jù)中心的采購需求。

盡管 NVIDIA 憑借其深厚、完善且?guī)缀蹼y以撼動的軟件生態(tài),以及全套數(shù)據(jù)中心硬件基礎(chǔ)設(shè)施建立起技術(shù)壁壘,但這一點似乎并未被投資者重視 —— 他們?nèi)栽敢庀驇缀跛行Q能研發(fā)出更快、更智能、更經(jīng)濟的 AI 處理器的團隊伸出橄欖枝。

不出所料,絕大多數(shù)初創(chuàng)企業(yè)都將研發(fā)重心放在數(shù)據(jù)中心或邊緣端的 AI 推理芯片上。AI 訓(xùn)練芯片的研發(fā)需要極高的資金投入,這一領(lǐng)域的市場份額基本已被 NVIDIA 牢牢占據(jù),多數(shù)初創(chuàng)企業(yè)都選擇主動退讓。

但對絕大多數(shù)這類初創(chuàng)企業(yè)而言,成功的窗口正逐漸關(guān)閉。2018 年是 AI 處理器初創(chuàng)企業(yè)的集中成立期,截至彼時,75% 的相關(guān)初創(chuàng)企業(yè)已成立。值得關(guān)注的是,初創(chuàng)企業(yè)數(shù)量的增長浪潮,早在 NVIDIA 的業(yè)務(wù)迎來爆發(fā)式增長、震撼整個科技行業(yè)之前就已開啟。

人們或許會認為,是 NVIDIA 的成功吸引了大批初創(chuàng)企業(yè)入局,但事實上,58% 的初創(chuàng)企業(yè)在 NVIDIA 崛起前就已啟動。2022 年以來,該領(lǐng)域年均發(fā)生 7 起收購案;2020 年至今,已有 17 家 AI 處理器初創(chuàng)企業(yè)完成首次公開募股。

AI 芯片初創(chuàng)企業(yè)的復(fù)雜市場格局

從基礎(chǔ)層面來看,AI 處理器是一款經(jīng)特殊優(yōu)化的芯片,可通過高速完成海量張量運算、最大限度減少數(shù)據(jù)遷移,實現(xiàn)神經(jīng)網(wǎng)絡(luò)工作負載的高速、高效運行。目前市場上的 AI 處理器類型繁多,涵蓋 GPU、NPU、存內(nèi)計算 / 處理芯片、神經(jīng)形態(tài)處理器以及矩陣 / 張量引擎。

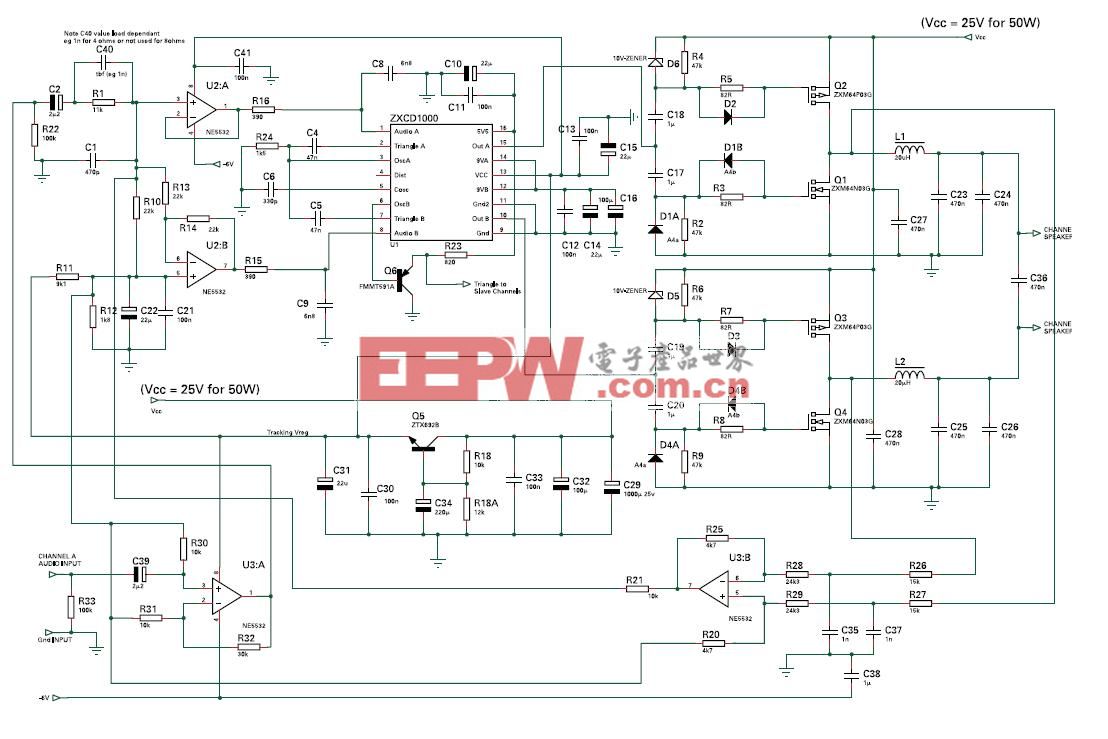

盡管 CPU 和 FPGA 也可用于運行 AI 工作負載,但由于二者的通用性,無法依據(jù)功能進行細分,因此通常被排除在規(guī)模達 850 億美元的 AI 芯片市場之外。不過,搭載向量擴展或單指令多數(shù)據(jù)引擎的 CPU(如今幾乎所有 CPU 均具備該特性),仍歸屬于 AI 處理器的范疇。CPU、片上系統(tǒng)和專用集成電路在 AI 領(lǐng)域的應(yīng)用重疊性,令人難以厘清(見圖1)。

1. 用于AI訓(xùn)練和推理的CPU、SoC和ASIC之間的復(fù)雜重疊。

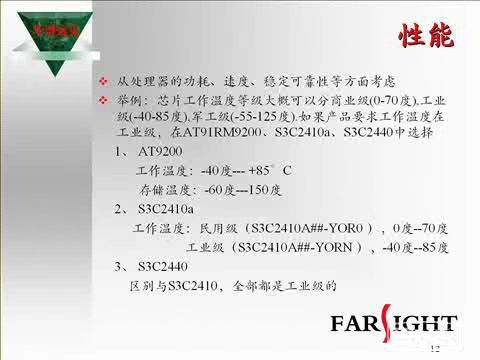

從核心架構(gòu)來看,AI 處理器由多個核心模塊構(gòu)成(見圖2):

計算模塊:大位寬單指令多數(shù)據(jù) / 單指令多線程核心(GPU 架構(gòu))、張量 / 矩陣引擎、向量運算單元、激活函數(shù)運算單元;

存儲層級:靠近計算模塊、容量小且速度快的片上靜態(tài)隨機存取存儲器;位于處理器外部或同封裝內(nèi)、容量更大的高帶寬存儲器 / 雙倍數(shù)據(jù)率存儲器;高速緩存 / 暫存器;預(yù)取器 / 直接存儲器訪問控制器(存內(nèi)計算芯片大致歸屬于這一范疇);

互連模塊:片上網(wǎng)絡(luò),以及包括但不限于高速串行計算機擴展總線、緩存一致性互連技術(shù)、NVIDIA 專屬互連技術(shù)和以太網(wǎng)在內(nèi)的片外互連鏈路;

控制模塊:指令處理器、調(diào)度器,以及用于內(nèi)核 / 集合通信的微碼。

2. 典型AI芯片的基本組件,包括計算、內(nèi)存和連接性。

AI 處理器的應(yīng)用場景覆蓋云端服務(wù)、數(shù)據(jù)中心芯片、嵌入式知識產(chǎn)權(quán)核以及神經(jīng)形態(tài)硬件。創(chuàng)業(yè)團隊和工程師們的研發(fā)方向,主要聚焦于彌補 CPU 和 GPU 的技術(shù)短板:內(nèi)存管理、小批量任務(wù)下的高利用率保障、嚴格功耗預(yù)算下的低延遲實現(xiàn),以及規(guī)模化部署后的穩(wěn)定吞吐量輸出。

各企業(yè)的產(chǎn)品研發(fā)主要圍繞兩大維度展開:一是工作負載類型,包括 AI 訓(xùn)練、AI 推理和傳感器級信號處理;二是部署層級,從超大規(guī)模數(shù)據(jù)中心,到依靠電池供電的可穿戴設(shè)備全覆蓋。

當前,AI 芯片的核心技術(shù)研發(fā)主要集中在內(nèi)存管理和執(zhí)行控制兩大方向。存內(nèi)計算和模擬計算技術(shù),可通過在存儲陣列內(nèi)完成運算、將部分和數(shù)據(jù)就近存儲,減少數(shù)據(jù)遷移,進而催生出全新的數(shù)據(jù)流設(shè)計架構(gòu);晶圓級芯片則將激活值存儲在本地靜態(tài)隨機存取存儲器中,為長序列任務(wù)實現(xiàn)權(quán)重數(shù)據(jù)的流式傳輸。

可重構(gòu)架構(gòu)能夠在編譯階段調(diào)整數(shù)據(jù)流和分塊策略,實現(xiàn)多層網(wǎng)絡(luò)的利用率優(yōu)化;AI 訓(xùn)練芯片著重提升互連帶寬和集合通信能力,而 AI 推理芯片則將研發(fā)重點放在單批次任務(wù)低延遲、Transformer 模型鍵值緩存、邊緣端能效,以及降低云端依賴以減少延遲上 —— 這一點在智能體機器人領(lǐng)域尤為關(guān)鍵。

AI 處理器的市場落地,取決于企業(yè)的商業(yè)化策略和生態(tài)體系支持。云服務(wù)提供商正將 AI 加速器集成至托管服務(wù)和模型推理框架中;知識產(chǎn)權(quán)核供應(yīng)商則與手機、汽車和工業(yè)領(lǐng)域的片上系統(tǒng)研發(fā)團隊展開合作,提供工具鏈、模型庫和芯片密度升級路線圖。

此外,邊緣計算領(lǐng)域的專業(yè)企業(yè)會推出軟件開發(fā)工具包,實現(xiàn)模型壓縮、8 位及更低精度的量化,并將算子映射至稀疏或模擬運算單元,同時保障模型精度達標;神經(jīng)形態(tài)芯片研發(fā)團隊則會發(fā)布脈沖神經(jīng)網(wǎng)絡(luò)編譯器,重點優(yōu)化事件流處理的能效和延遲表現(xiàn)。實踐表明,編譯器、內(nèi)核集和可觀測性工具的優(yōu)化,其重要性往往超過芯片的峰值算力。

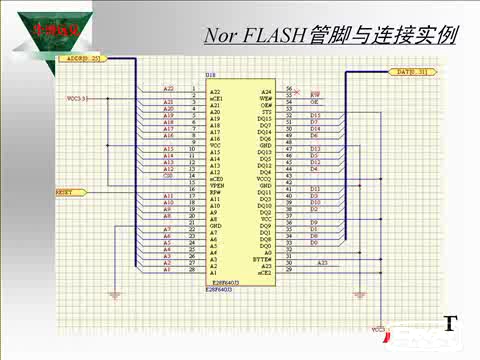

不同部署層級的 AI 芯片,競爭焦點也各不相同(見圖3):AI 訓(xùn)練芯片的競爭核心是單模型訓(xùn)練成本,需綜合考量網(wǎng)絡(luò)、內(nèi)存和編譯器的限制;AI 推理芯片則在延遲約束下,以單令牌或單幀處理成本為競爭目標,緩存管理和量化技術(shù)是核心優(yōu)化手段;邊緣設(shè)備芯片的競爭集中在單推理任務(wù)的毫瓦級功耗和工具鏈的可移植性;知識產(chǎn)權(quán)核供應(yīng)商則比拼流片周期、功耗 - 性能 - 面積指標,以及驗證支持能力;科研項目則需要在產(chǎn)品上市速度,與可能改變內(nèi)存、計算、通信三者權(quán)衡關(guān)系的實驗研究之間找到平衡。

3. 按市場細分的人工智能芯片公司分布。

整個研發(fā)過程中,各團隊會根據(jù)具體需求定制芯片設(shè)計,例如注意力機制深度、參數(shù)量、激活值規(guī)模、稀疏性和精度策略等。當企業(yè)實現(xiàn)芯片、編譯器和部署工具的協(xié)同優(yōu)化時,就能有效降低集成成本,加快從模型研發(fā)到高吞吐量落地的轉(zhuǎn)化速度。

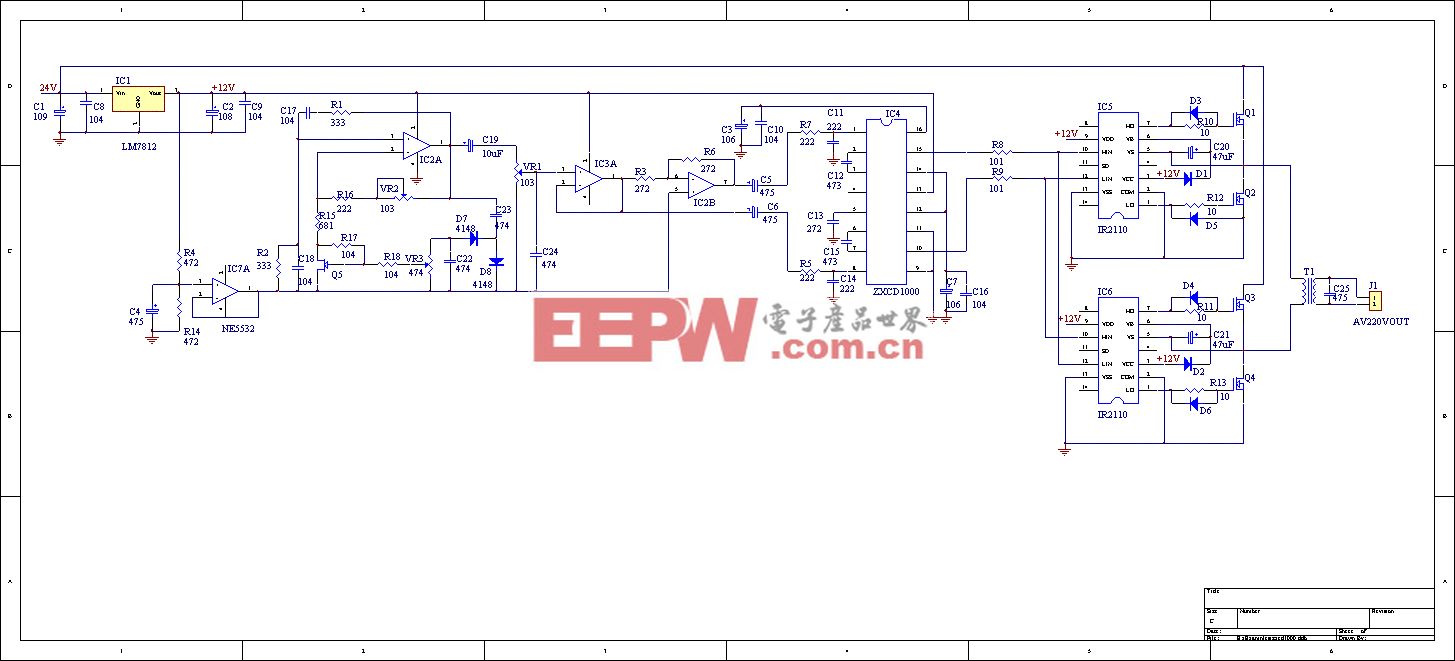

客戶則擁有多種選擇:在云端拓展算力、通過晶圓級系統(tǒng)實現(xiàn)算力擴容、將 NPU 集成至片上系統(tǒng),或是利用模擬芯片和神經(jīng)形態(tài)芯片,將計算單元部署在更靠近傳感器的位置。280 億美元的投資,正源源不斷地流入這些海量的研發(fā)工作中,也正是這些技術(shù)研發(fā)成果,讓這些初創(chuàng)企業(yè)成為極具吸引力的收購標的(見圖4)。

4. 基于處理器類型分發(fā)AI芯片初創(chuàng)企業(yè)。

AI 芯片初創(chuàng)企業(yè)的爆發(fā)式增長終章

但這場 AI 芯片領(lǐng)域的 “寒武紀大爆發(fā)”,正迎來落幕時刻。2025 年末,首個市場信號出現(xiàn):投資者開始對超大規(guī)模數(shù)據(jù)中心運營商、政府和私營企業(yè)的巨額硬件設(shè)備支出感到擔憂,這也在以 AI 熱潮為主要驅(qū)動力的股市中引發(fā)了連鎖反應(yīng)(見圖5)。各大媒體紛紛熱議 AI 芯片市場的泡沫,以及泡沫破裂的時間預(yù)測。

5. 全球人工智能處理器供應(yīng)商的人口。

暗流涌動之下,AI 芯片供應(yīng)商的市場泡沫注定破裂 —— 畢竟,沒有任何一個行業(yè)能支撐 146 家供應(yīng)商共存。

截至 2025 年底,該領(lǐng)域已發(fā)生多起收購案和企業(yè)倒閉事件,累計達 21 起,后續(xù)還將有更多企業(yè)退出市場。但風險投資機構(gòu)仍在賭概率:他們認為,六家融資額均超 10 億美元的頭部初創(chuàng)企業(yè)將成為最終幸存者,而其余百余家初創(chuàng)企業(yè),要么被 37 家有收購意向的上市公司收入囊中,要么走向倒閉。Jon Peddie Research 的預(yù)測顯示,未來一到兩年,獨立 AI 芯片供應(yīng)商的數(shù)量將縮減 40%,實際行業(yè)洗牌的結(jié)果可能會更嚴峻。

盡管絕大多數(shù)初創(chuàng)企業(yè)終將面臨被收購或倒閉的結(jié)局,但被收購的企業(yè)也會帶來意外價值 —— 由熱情且樂觀的風險投資機構(gòu)買單的免費知識產(chǎn)權(quán)核。280 億美元的投資,足以支撐大量的研發(fā)工作,尤其是這些初創(chuàng)企業(yè)的平均員工數(shù)還不足 10 人。反觀 NVIDIA,目前擁有約 3.6 萬名員工,這場競爭從一開始就并非勢均力敵。

這些收購案的背后,難免會有人為錯失的發(fā)展機遇感到惋惜,但如果企業(yè)的創(chuàng)業(yè)愿景僅僅是 “研發(fā)出更優(yōu)秀的處理器,就會吸引全世界的客戶主動上門”,那么這份惋惜便毫無意義。

NVIDIA 的行業(yè)主導(dǎo)地位,不僅依托其 AI GPU 的性能優(yōu)勢和深厚的軟件生態(tài),更在于其始終聚焦于打造全套數(shù)據(jù)中心硬件基礎(chǔ)設(shè)施 —— 這一核心布局,讓其始終保持行業(yè)領(lǐng)先。

評論